RepomindAI: So baut man KI-Coding-Agenten für ganze Repositories – und was das für die Dev-Zukunft bedeutet

Repo-Scale AI-Coding-Agenten: Was das RepomindAI-Projekt über die Entwicklung von morgen verrät

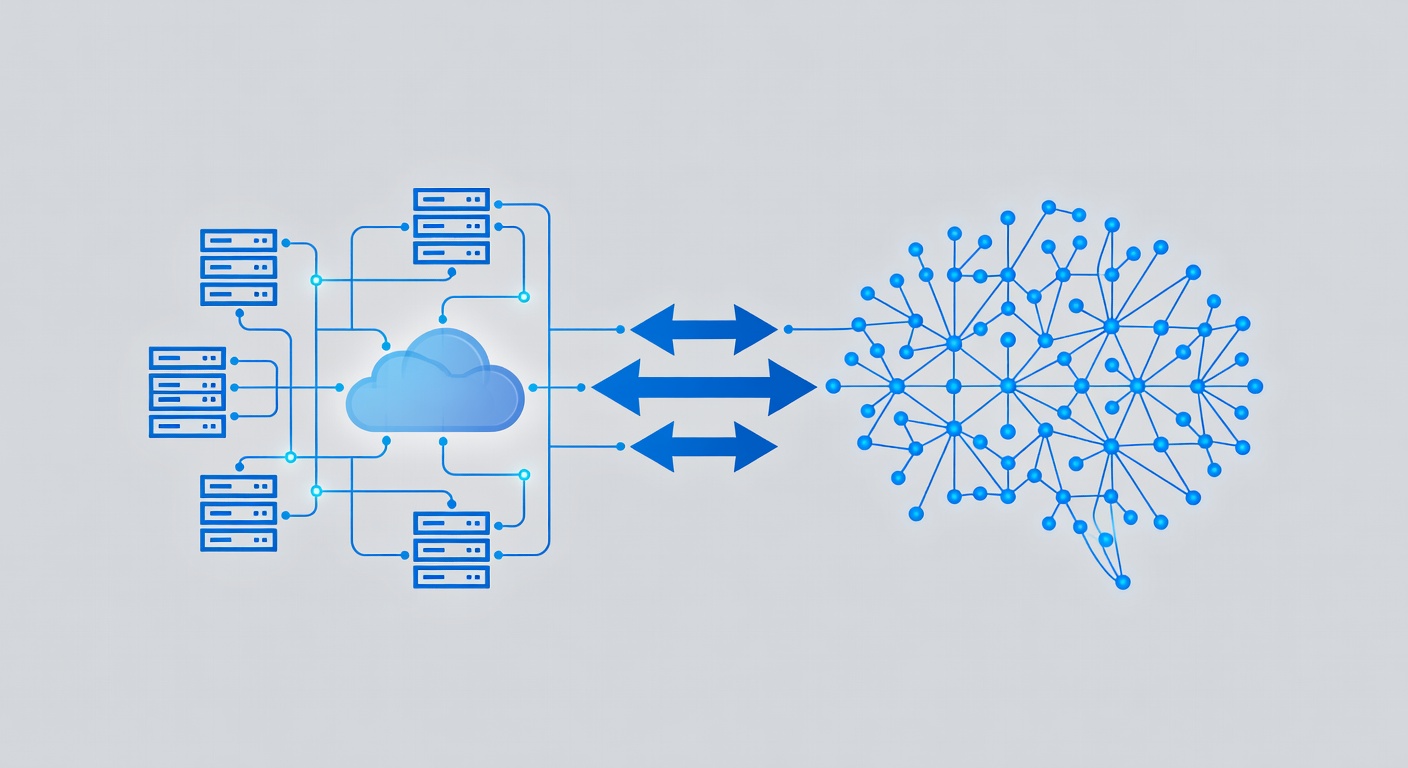

AI-Tools für Entwickler boomen. Doch die meisten bleiben bei einzelnen Dateien oder Funktionen stecken. Sie sehen nicht den großen Zusammenhang deines Codes. RepomindAI ändert das grundlegend.

Das Kontext-Problem beim modernen Coding

Stell dir vor: Du arbeitest in einem Monorepo mit Hunderten Dateien. Du willst eine Komponente umbauen. Der AI-Assistent checkt nur diese eine Datei. Er kennt nicht die Verbindungen zu Dutzenden Services, Utilities oder dem Gesamtaufbau.

Frühere Modelle hatten winzige Kontextfenster. GPT-4 startete mit 8K Tokens, später 128K. Für ein echtes Repo reicht das nicht. Du brauchst Tests, Configs, Docs, Dependencies und Implementierungen – alles auf einmal.

256K-Kontext und AMD MI300X im Einsatz

RepomindAI nutzt die AMD MI300X GPU für "repo-scale" Verständnis. Mit 256K Tokens lädst du ganze Systemteile ins Gedächtnis. Das sind rund 190.000 Wörter – wie ein ganzer Roman.

Für Repos bedeutet das:

- Verbundene Module komplett

- Vollständige Test-Suiten

- Architektur-Docs

- Alle Configs

- APIs und Verträge

- Gemeinsame Libraries

Alles gleichzeitig greifbar.

FP8: Der Effizienz-Trick

Clever ist auch FP8-Quantisierung. Normale Modelle rechnen in FP32-Präzision. FP8 schrumpft auf 8 Bit – ohne nennenswerten Qualitätsverlust dank smarter Techniken.

Vorteile:

- Schnellere Inference: Weniger Rechenaufwand

- Weniger Speicher: Mehr Platz für Kontext

- Geringerer Stromverbrauch: Gut für lange Läufe

- Günstiger Betrieb: Skalierbar und kosteneffizient

Perfekt für Produktions-Deployment. Jede Sekunde zählt, jeder Byte spart Nutzer.

So tickt ein smarter Coding-Agent

RepomindAI geht über langes Kontextfenster hinaus. Es baut agentisches Verhalten auf – der AI denkt mit, statt nur Code zu spucken.

Ein Top-Agent kann:

- Dependencies kartieren: Welche Datei holt was woher?

- Muster erkennen: Dein Projekt-Stil und Architektur

- Auswirkungen abschätzen: Änderung in A trifft B, C, D

- Passende Lösungen bauen: Passend zur Code-Philosophie

- Nachfragen: Bei unklaren Stellen nachhaken

Kein simpler Autocomplete, sondern echter Partner.

Warum das dein Infra verändert

Für Startups oder Teams ein Gamechanger: Schnelleres Onboarding: Neulinge laden Repo – AI erklärt Struktur, generiert Docs, führt durch. Sicheres Refactoring: Vollständige Dependency-Übersicht minimiert Risiken. Frische Docs: Automatisch und aktuell. Architektur-Check: Debt aufspüren, Verbesserungen vorschlagen. Multi-Service-Debugging: Probleme über Services hinweg schnell finden.

Open Source macht's möglich

RepomindAI ist Open Source. Kein Cloud-Gigant-Ding, sondern Community-Projekt. Es kombiniert:

- Freie AI-Modelle

- Erreichbare GPUs wie MI300X

- Smarte Kontext- und Quantisierungs-Tricks

- Mitmacher-Beiträge

Das öffnet Türen. Keine Token-Rechnungen bei Big Tech. Lauf es selbst, bei sensiblen Codes.

Ausblick: AMD Hackathon 2026

Entstanden beim AMD Developer Hackathon. Hardware-Hersteller pushen jetzt Dev-Tools und AI-Infra. Es geht um Ökosysteme, nicht nur Power.

Bleib dran, wenn du AI-Dev, On-Premise-Infra oder Domains/Hosting managst. Solche Projekte zeigen, was heute läuft.

Takeaways für deinen Stack

Bei Hostingwahl, AI-Integration oder Branchentrends: RepomindAI liefert Klarheit:

- Kontext regiert: Große Fenster revolutionieren AI-Coding.

- Effizienz zählt: FP8 bringt High-End auf kleine Setups.

- Open Source vorne: Community überholt Konzerne.

- GPU-Strategie: AMDs Zugang verändert den Markt.

Coding-Hilfe wird kollegial: Versteht dein Repo, deine Entscheidungen, deine Limits.

RepomindAI ist der Startschuss.