Byg repo-størrelses AI-kodere: RepomindAI's store lektioner til fremtidens udvikling

Bygger AI-kodningsagenter i repositorieskala: Lektioner fra RepomindAI-projektet om fremtiden for udvikling

Hvis du følger med i AI-værktøjer til udviklere, har du sikkert mærket en irriterende begrænsning. De fleste kodningsassistenter kigger kun på enkeltfiler eller funktioner. De er nyttige, men mangler overblik over hele din kodebase. RepomindAI tackler det her på en smart måde.

Kontekstproblemet i nutidens udvikling

Forestil dig det her: Du arbejder i et monorepo med hundredvis af filer. Du vil have AI til at refaktorere en komponent. Assistenten kender filen, men ikke hvordan modulet hænger sammen med 17 andre services, delte utilities eller projektets arkitektoniske mønstre.

Klassiske sprogmodeller har stramme kontekstgrænser. GPT-4 startede med 8K tokens, senere 32K og 128K. Men til komplekse repositories med krydsende services? Det kræver testfiler, konfigurationer, docs, afhængigheder og kode på tværs af dusinvis af filer – alt på én gang.

256K-kontekst og AMD MI300X åbner nye døre

RepomindAI bruger AMD MI300X GPU til "repo-scale" forståelse. Med 256K kontekstvindue loader du ikke bare én fil ind. Hele subsystemer passer ind i hukommelsen.

Perspektiv: 256K tokens svarer til ca. 190.000 ord – som en hel roman. I kode betyder det:

- Flere afhængige moduler

- Fuldstændige testsuites

- Arkitektdocs

- Konfigurationsfiler over hele projektet

- API-definitioner

- Delte biblioteker

Alt simultaneously.

FP8 gør det effektivt

Et andet trick er FP8-kvantisering. Almindelige modeller kører på FP32-præcision (32-bit). FP8 skærer det ned til 8-bit. Lyder risikabelt, men nye teknikker holder nøjagtigheden intakt.

Fordelene? Ren effektivitet:

- Hurtigere inference: Mindre beregninger går lynhurtigt

- Mindre hukommelsesforbrug: Plads til længere kontekst på samme hardware

- Lavere strøm: Perfekt til GPU-tunge jobs

- Bedre økonomi: Billigere at skalere

For udviklere med produktions-AI-agenter betyder det bedre UX, flere brugere og lavere omkostninger.

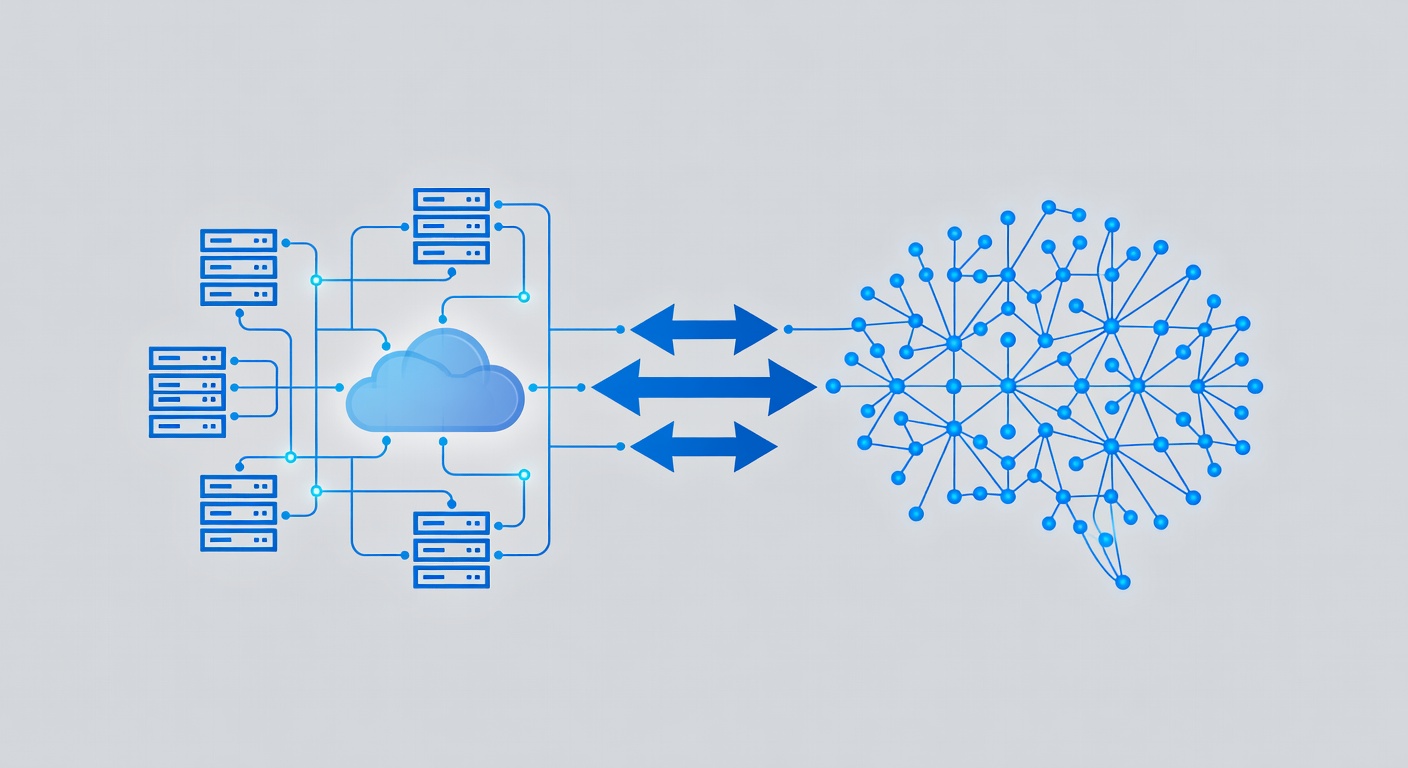

Hvordan en smart kodningsagent hænger sammen

RepomindAI er mere end lang kontekst i en model. Fokus er på agentic behavior – en agent, der ikke kun genererer kode, men resonnerer om repo-struktur og problemløsning.

En rigtig repo-scale agent kan:

- Kortlægge afhængigheder: Se imports og deres rolle

- Spot patterns: Genkende projektets arkitektur og stil

- Vurdere konsekvenser: Vide, at ændringer i modul A rammer services B, C og D

- Foreslå smarte løsninger: Ændringer, der passer til kodens filosofi

- Stille spørgsmål: Bed om mere info ved tvivl

Det er milevidt fra autocompletion eller simple refaktoreringer.

Hvad det betyder for din infrastruktur

Hvis du driver startup eller team, tænk på potentialet:

Hurtigere onboarding: Nye devs uploader kodebasen og får arkitektur-walkthroughs, auto-docs og intro til nøglesystemer.

Sikkere refaktorering: Store ændringer bliver mindre risikable med fuldt overblik over dependency graph og breakings.

Frisk dokumentation: AI genererer opdateret docs baseret på reel kode.

Arkitekttjek: Analyse af struktur, tech debt og risici.

Debug over services: Bedre sporing af krydsfejl end manuel logjagt.

Open source-potentialet

RepomindAI er open source – ikke en lukket cloud-gigant-løsning. Det kombinerer:

- Frie AI-modeller

- Tilgængelige GPU'er (AMD MI300X bliver bredere)

- Smart kontekst- og kvantiseringsdesign

- Fællesskabsbidrag

Det democratiserer tech. Startups og solo-devs kan teste uden token-afgifter. Kør det på egen infra, behold kontrol over sensitiv kode.

Fremtiden: AMD Developer Hackathon 2026

Projektet kom fra AMD Hackathon. Det viser trenden: Hardware-firmaer satser på dev-tools og AI-infra. Det handler ikke kun om rå GPU-kraft, men økosystemer til innovation.

Følg RepomindAI, hvis du er til AI-dev, domain management eller on-prem AI.

Konsekvenser for din tech stack

Ved valg af hosting, AI i workflow eller brancheoverblik giver RepomindAI disse pointer:

- Kontekst ændrer alt: Længere windows revolutionerer AI-dev.

- Effektivitet er nøglen: FP8 gør avancerede AI realistisk i mindre skala.

- Open source leder: Fællesskabsværktøjer overgår ofte corporate.

- GPU-valg tæller: AMDs tilgængelighed kan ændre AI-landskabet.

Fremtidens kodning er ikke smart auto-complete. Det er en partner, der kender dit projekt, valg, patterns og begrænsninger.

RepomindAI er starten.