Jak RepomindAI buduje AI do kodowania na skalę repozytorium – lekcje dla przyszłości programowania

Agenci AI do kodowania na skalę całego repozytorium: Lekcje z projektu RepomindAI i przyszłość programowania

Śledzisz nowinki z AI w narzędziach deweloperskich? Zauważyłeś pewnie irytujący problem. Większość asystentów kodowania patrzy tylko na pojedynczy plik lub funkcję. Pomagają, jasne. Ale nie widzą całego obrazu twojego kodu. Tu wkracza kontekst – i projekt RepomindAI pokazuje, jak to ogarnąć.

Problem z kontekstem w dzisiejszym devie

Wyobraź sobie: siedzisz w monorepo z setkami plików. Chcesz zrefaktorować komponent. AI ogarnia ten jeden plik. Ale nie wie, jak twój moduł łączy się z kilkunastoma innymi serwisami. Nie rozumie shared utilities ani wzorców architektonicznych w projekcie.

Tradycyjne modele miały sztywne limity kontekstu. GPT-4 zaczynał od 8K tokenów, potem 32K, 128K. Ale złożone repozytorium? Tu trzeba zajrzeć do testów, configów, docs, drzewa zależności i dziesiątek plików naraz.

256K okna kontekstu dzięki AMD MI300X

RepomindAI korzysta z GPU AMD MI300X. To pozwala na "repo-scale" – zrozumienie całego repozytorium. 256K tokenów to jakieś 190 tysięcy słów. Jak powieść w jednym podejściu. W kodzie oznacza to wczytanie:

- Zależnych modułów

- Pełnych suite'ów testowych

- Dokumentacji architektury

- Configów z całego projektu

- Definicji API i kontraktów

- Wspólnych bibliotek

Wszystko jednocześnie.

Sztuczka z FP8 dla efektywności

Kluczowa jest też kwantyzacja FP8. Zwykłe modele LLM używają FP32 – 32 bity na liczbę. FP8 to tylko 8 bitów. Brzmi ryzykownie? Nowe techniki pokazują, że dokładność zostaje prawie nietknięta.

Dlaczego to ważne? Efektywność:

- Szybszy inference: Mniejsze operacje liczą się błyskawicznie

- Mniej pamięci: Więcej miejsca na długi kontekst w tym samym sprzęcie

- Niższe zużycie prądu: Kluczowe przy ciężkich zadaniach GPU

- Lepsza opłacalność: Tańsze skalowanie

Dla devów myślących o produkcji AI to złoto. Każda milisekunda mniej w odpowiedzi to lepszy UX. Oszczędzona pamięć – więcej userów naraz.

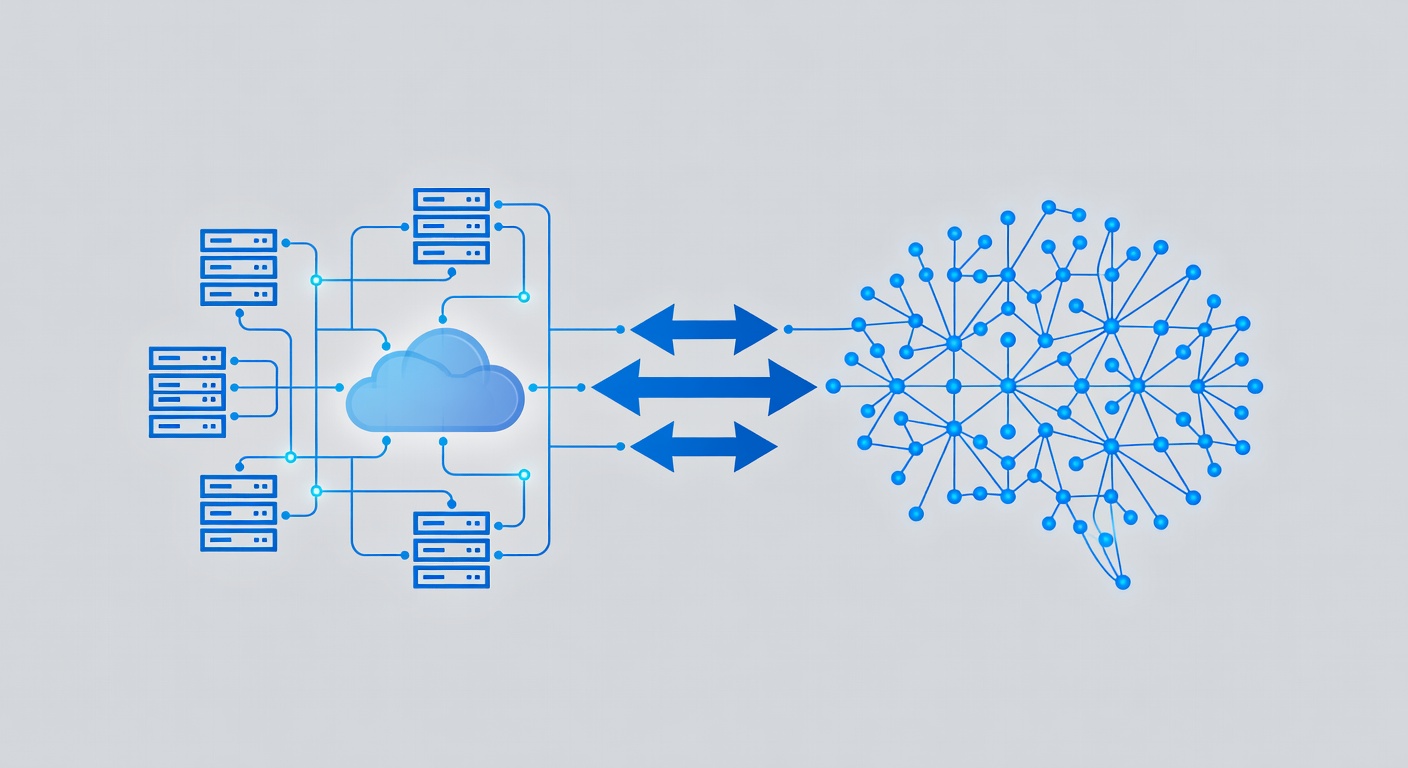

Jak działa inteligentny agent kodujący

RepomindAI to nie tylko dłuższy kontekst wrzucony w model. Stawia na agentic behavior – system, który nie tylko generuje kod, ale analizuje strukturę repo i sposób myślenia o problemie.

Prawdziwy agent repo-scale powinien:

- Mapować zależności: Wiedzieć, co skąd importuje i po co

- Rozpoznawać wzorce: Łapać style kodu i architekturę projektu

- Przewidywać skutki: Zrozumieć, że zmiana w Module A rozwali Services B, C i D

- Proponować spójne fixy: Nie tylko syntax, ale zmiany pasujące do filozofii kodu

- Pytać o szczegóły: Domagać się wyjaśnień, gdy coś niejasne

To krok dalej niż auto-complete czy proste refaktoringi.

Co to zmienia w twojej infrastrukturze

Prowadzisz startup lub team dev? Taki agent to rewolucja:

Szybszy onboarding: Nowi deweloperzy wrzucają repo i dostają tour po architekturze, generowane docs i intro do kluczowych systemów.

Bezpieczne refaktoringi: Duże zmiany mniej ryzykowne – AI zna graf zależności i wyłapuje breakery.

Automatyczne docs: Świeże, zgodne z kodem – koniec z przestarzałymi README.

Review architektury: AI analizuje strukturę, wskazuje tech debt i problemy.

Debug cross-service: Błędy rozłożone na serwisy? AI śledzi je lepiej niż ręczne logi.

Szansa open source

RepomindAI to open source. Nie zamknięty produkt od chmury giganta – to badanie społeczności. Pokazuje, co da się zrobić z:

- Dostępnymi modelami open source

- GPU jak AMD MI300X (coraz szerzej dostępne)

- Sprytnym zarządzaniem kontekstem i kwantyzacją

- Wkładami community

To demokratyzacja. Startup czy solo dev testuje bez płacenia za tokeny. Możesz uruchomić na własnym hardware, trzymając kod pod kontrolą.

Przyszłość: Hackathon AMD Developer 2026

Projekt powstał na AMD Developer Hackathon. Trend jasny: producenci hardware inwestują w narzędzia dev i AI infra. Nie tylko surowa moc GPU – budują ekosystemy do innowacji.

Dla fanów AI w devie, zarządzania domenami czy on-prem AI – śledź takie projekty. Pokazują, co działa tu i teraz.

Wnioski dla twojego tech stacku

Planujesz hosting, integrację AI w workflow czy po prostu śledzisz trendy? RepomindAI daje wskazówki:

- Kontekst rządzi: Dłuższe okna zmieniają AI-assisted dev na zawsze

- Efektywność kluczem: FP8 czyni zaawansowane AI realnym na mniejszą skalę

- Open source napędza: Community tools wyprzedzają korpo

- Architektura GPU liczy się: AMD otwiera dostęp do mocy

Przyszłość kodowania to nie sprytny auto-complete. To partner rozumiejący cały projekt, wybory architektoniczne, wzorce i limity.

RepomindAI to dopiero start.