RepomindAI 项目揭秘:仓库级 AI 编程代理如何重塑开发未来

仓库级AI编程助手:RepomindAI项目告诉你开发未来啥样

最近AI编程工具火了,但有个大问题:大多数只看单个文件或函数。帮得上忙,可它不懂你整个代码库的全貌。这时候,上下文就关键了。RepomindAI项目在这儿玩出了新花样。

现代开发里的上下文难题

想象一下:你搞monorepo,几百个文件。要AI帮你重构一个组件。它看懂了那个文件,可不知道它怎么跟其他17个服务连着?共享工具怎么用?项目架构啥风格?

老语言模型上下文超有限。GPT-4起步8K token,后来32K、128K。可复杂仓库呢?得同时看测试文件、配置、文档、依赖树、几十个文件的实现细节。光靠窗口塞不下。

256K上下文窗口+AMD MI300X登场

RepomindAI用上AMD MI300X GPU,搞出了“仓库级”理解。256K上下文窗口,不再只盯一文件——整个子系统一下全塞进内存。

啥概念?256K差不多19万字,等于一口气读完一本长小说。对代码库来说,能同时加载:

- 互相依赖的模块

- 全套测试

- 架构文档

- 项目所有配置

- API定义和契约

- 共享工具和库

全在眼前。

FP8量化:效率大招

还有个聪明设计:FP8量化。传统大模型用FP32(32位浮点)。FP8砍到8位,听着精度低,但新技术证明,AI性能基本不掉。

为啥牛?效率高:

- 推理更快:数字运算小,速度飞起

- 内存省:同硬件塞更长上下文

- 功耗低:GPU重负载不费电

- 成本低:大规模跑起来便宜

对想上线AI代理的开发者超实用。每毫秒推理快点,用户体验就好。内存省点,就能多伺候用户。

智能编程代理的架构

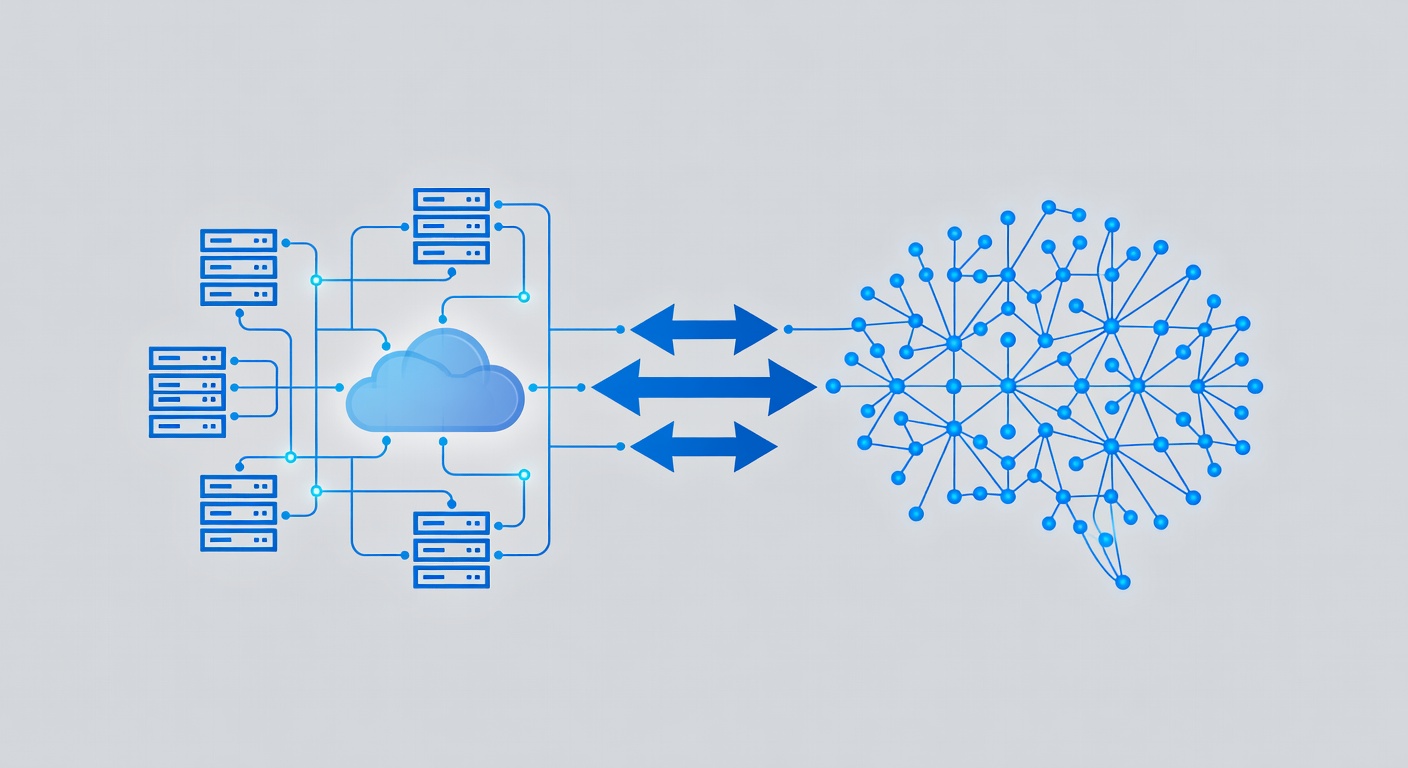

RepomindAI不光扔大上下文给模型。它玩“代理行为”——不只吐代码,还主动分析仓库结构、解决问题思路。

真仓库级代理得会:

- 描依赖:知道哪个文件从哪引,为什么

- 认模式:抓项目特有架构和代码风格

- 想影响:改A模块,会波及B、C、D服务

- 出方案:不光修语法,还贴合代码哲学改动

- 问问题:上下文模糊时,主动求澄清

这可不是简单补全或重构建议。

对你基础设施的意义

startup老板或团队领头想想:仓库级AI代理能干啥?

加速入职:新人上传代码库,AI秒给架构导览、生成文档、带你逛关键系统。

重构稳:大改项目风险小,AI懂全依赖图,列出所有潜在坑。

文档自动:生成准文档,跟代码实况同步(别再看过时README)。

架构审:AI扫仓库,提改进、挖技术债、标隐患。

跨服务debug:问题跨服务,AI全景追踪,比手动翻日志快。

开源机会

RepomindAI开源最赞。不像大云商的封闭货,是社区研究,秀出啥组合牛:

- 开源AI模型人人用

- AMD MI300X这种GPU更普及

- 上下文管理和量化工程

- 社区迭代

这民主化关键。startup和独狼开发者不用给云巨头发token钱。自己基础设施跑,敏感代码全控。

展望:AMD开发者黑客松2026

项目出自AMD开发者黑客松,信号明显:硬件厂商投开发工具和AI基建。不止卖GPU,还建生态,让开发者玩前沿AI。

对AI辅助开发、域名托管、on-prem AI基建感兴趣的,都盯紧RepomindAI。它秀出现状,不是十年后梦。

对你技术栈的启发

挑hosting商、加AI进开发流,或单纯跟行业脉搏?RepomindAI给干货:

- 上下文为王:大窗口彻底变AI开发玩法

- 效率第一:FP8优化让高级AI小规模也行

- 开源领风:社区工具迭代比企业快

- GPU架构关键:AMD让强硬件亲民,重塑AI开发

编程助手未来不是聪明自动补全。是懂你全项目、架构、模式、限制的伙伴系统。

RepomindAI只是开端。