RepomindAI onthult: zo bouw je repository-grote AI-codeeragenten voor de toekomst van development

Repo-schaal AI voor coderen: Lessen uit RepomindAI voor de toekomst van development

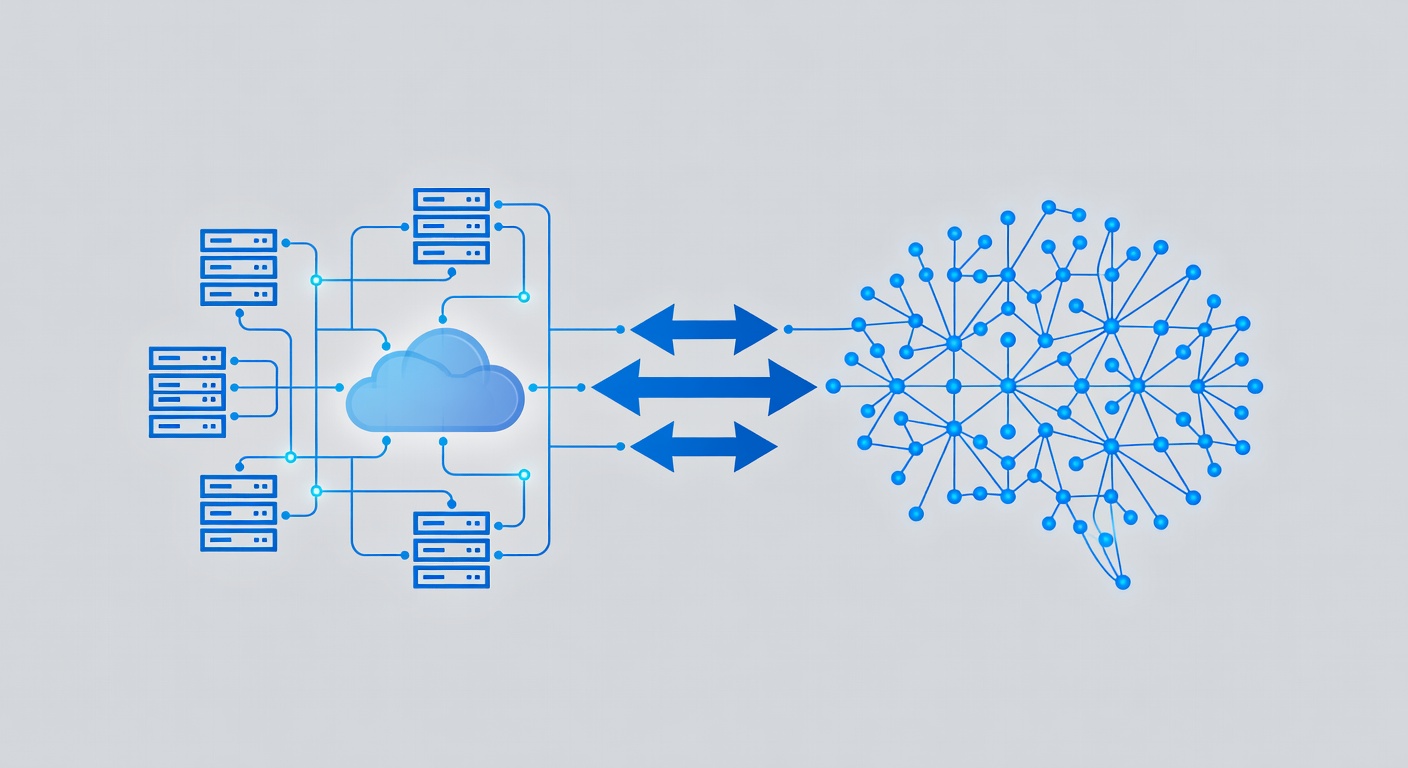

AI-tools voor developers maken indruk, maar struikelen vaak over het gebrek aan overzicht. Ze snappen een los bestand, maar missen de grote lijn van je hele codebase. RepomindAI pakt dit aan op een slimme manier.

Het probleem met context in development

Stel: je werkt in een monorepo vol honderden bestanden. Je wilt een component refactoren. De AI ziet dat ene bestand, maar niet hoe het past in zeventien services, shared utilities of je architectuur.

Vroegere modellen hadden strakke limieten, zoals 8K of 128K tokens bij GPT-4. Voor een complex repo heb je tests, configs, docs, dependencies en code uit tientallen bestanden nodig. Alles tegelijk.

256K context en de kracht van AMD MI300X

RepomindAI gebruikt de AMD MI300X GPU voor 'repo-scale' begrip. Met 256K context laad je hele subsystemen in één keer.

Dat zijn zo'n 190.000 woorden – als een dikke roman. In code-termen:

- Meerdere gekoppelde modules

- Volledige test suites

- Architectuurdocs

- Configs over het hele project

- API-contracts

- Shared libraries

Alles tegelijk zichtbaar.

FP8 voor slimme efficiëntie

Nog slimmer: FP8-quantization. Normale modellen draaien op FP32. FP8 halveert dat naar 8-bit, zonder veel nauwkeurigheid te verliezen dankzij nieuwe technieken.

Voordelen?

- Snellere inference: Minder rekenwerk

- Minder geheugengebruik: Meer ruimte voor context op dezelfde hardware

- Lagere stroomkosten: Handig bij GPU-belasting

- Goedkoper op schaal: Ideaal voor productie

Voor developers betekent dit: snellere responses en meer users tegelijk.

Hoe bouw je een slimme coding agent?

RepomindAI gooit niet zomaar context erin. Het draait om agent-gedrag: de AI redeneert over je repo en problemen.

Een echte repo-scale agent kan:

- Dependencies in kaart brengen: Welk bestand haalt wat van waar?

- Patronen herkennen: Je architectuur en stijl snappen

- Impact voorspellen: Verandering in A raakt B, C en D

- Slimme fixes maken: Passend bij je code-filosofie

- Vragen stellen: Bij onduidelijke context

Geen simpele auto-complete, maar echte samenwerking.

Impact op je infrastructuur

Voor startups of teams verandert dit alles:

Snelle onboarding: Nieuwe devs krijgen direct repo-overzichten, docs en tours.

Veilig refactoren: AI ziet de hele dependency-graph en waarschuwt voor breaks.

Actuele docs: Automatisch gegenereerd uit je code.

Architectuur-checks: Suggesties voor verbeteringen en debt.

Debuggen over services: Problemen tracen zonder log-jacht.

Open source maakt het bereikbaar

RepomindAI is open source – geen gesloten cloud-monopolie. Het combineert:

- Open AI-modellen

- Toegankelijke GPUs zoals AMD MI300X

- Slimme context- en quantizatietechnieken

- Community-input

Zo experimenteren indie-devs en startups gratis, op eigen hardware. Volledige controle over je code.

Kijk naar AMD Developer Hackathon 2026

Dit project komt uit die hackathon. Hardware-bouwers als AMD investeren nu in AI-tools en ecosystems. Niet alleen power, maar innovatie voor devs.

Volg dit als je AI in development, on-premises infra of domeinbeheer wilt.

Lessen voor je tech stack

Bij hosting-keuzes of AI-workflows:

- Context regeert: Grotere windows openen nieuwe deuren

- Efficiëntie telt: FP8 maakt het haalbaar voor iedereen

- Open source versnelt: Community loopt voorop

- GPU-strategie: AMD maakt power toegankelijk

De toekomst? Geen autocomplete, maar een partner die je hele project snapt. RepomindAI is de start.