RepomindAI : les leçons d'un projet fou pour des agents IA qui codent à l'échelle repo

Agents IA pour Codebases Massives : Les Leçons du Projet RepomindAI sur l'Avenir du Dev

Les assistants IA pour codeurs ont un gros défaut. Ils se limitent souvent à un fichier ou une fonction. Pratiques, oui. Mais ils ignorent le reste de votre repo. RepomindAI change la donne avec une vision globale.

Le Défi du Contexte en Dev Moderne

Imaginez un monorepo avec des centaines de fichiers. Vous voulez refactoriser un composant. L'IA pige le fichier courant. Mais pas les liens avec d'autres services, les utils partagés ou les patterns d'architecture.

Les anciens modèles LLMs avaient des limites courtes. 8K tokens, puis 32K, 128K. Pour un repo complexe, il faut analyser tests, configs, docs, dépendances et implémentations sur des dizaines de fichiers en même temps.

256K Tokens Grâce à l'AMD MI300X

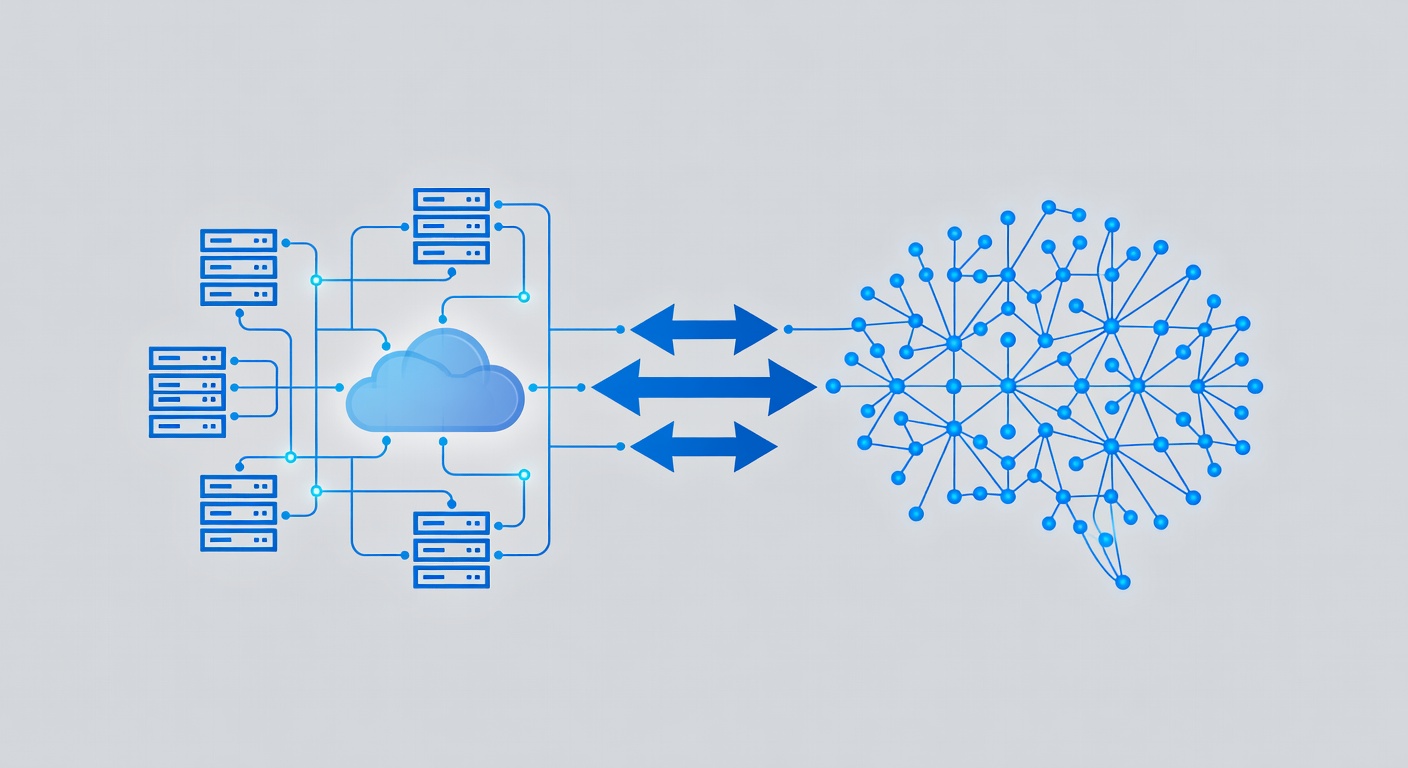

RepomindAI mise sur le GPU AMD MI300X pour une compréhension "repo-scale". Avec 256K tokens, on charge des sous-systèmes entiers en mémoire.

Ça fait environ 190 000 mots. Comme un roman complet. Dans un repo, ça permet d'inclure :

- Modules interconnectés

- Suites de tests complètes

- Docs d'architecture

- Fichiers de config du projet

- Définitions d'API

- Libs et utils partagés

Tout d'un coup.

L'Atout FP8 pour l'Efficacité

Le projet utilise aussi la quantization FP8. Les LLMs classiques tournent en FP32, 32 bits. FP8 descend à 8 bits sans perdre en précision, grâce aux techniques modernes.

Les gains ?

- Inférence plus rapide : Opérations numériques allégées

- Moins de mémoire : Plus de place pour les gros contextes

- Consos énergétiques réduites : Idéal pour les charges GPU

- Coûts en baisse : Scalable sans exploser le budget

Parfait pour déployer des agents IA en prod. Moins de latence, plus d'utilisateurs simultanés.

Comment Construire un Agent Codage Intelligent

RepomindAI ne se contente pas d'un gros contexte. Il adopte un comportement "agentique". L'IA raisonne sur la structure du repo et la résolution de problèmes.

Un vrai agent repo-scale doit :

- Cartographier les dépendances : Voir qui importe quoi et pourquoi

- Détecter les patterns : Styles et architectures propres au projet

- Évaluer les impacts : Savoir qu'un changement dans A touche B, C, D

- Proposer des solutions cohérentes : Alignées sur la philosophie du code

- Poser des questions : Clarifier les ambiguïtés

Loin du simple auto-complétion ou refactor basique.

Impacts sur Votre Infra

Pour une startup ou une équipe dev, un tel agent booste tout.

Onboarding rapide : Upload du repo, et l'IA guide sur l'architecture, génère des docs, introduit les systèmes clés.

Refactor sécurisé : Moins de risques sur les gros changements, grâce à la vue des dépendances.

Docs auto : À jour, basés sur le code réel.

Review d'architecture : Suggestions d'amélios, détection de dette tech.

Debug multi-services : Traçage des bugs transversaux, mieux que les logs manuels.

L'Open Source qui Démocratise

RepomindAI est open source. Pas un outil propriétaire de géant du cloud. C'est de la recherche communautaire qui combine :

- Modèles IA accessibles

- GPUs AMD MI300X pour tous

- Gestion fine du contexte et quantization

- Contributions collectives

Ça change tout. Les startups et devs solo testent sans factures cloud. Contrôle total sur les codebases sensibles.

Vers le Hackathon AMD 2026

Le projet vient d'un hackathon AMD Developer. Les fabricants de hardware investissent dans les outils dev et l'IA. Au-delà de la puissance brute, ils bâtissent des écosystèmes.

À suivre pour tout dev IA, gestion de domains ou infra on-prem.

Ce Que Ça Impose pour Votre Stack Tech

Que vous choisissiez un hosting, intégrez l'IA au workflow ou suivez les trends, RepomindAI éclaire :

- Contexte avant tout : Les fenêtres longues révolutionnent l'assistance dev

- Efficacité clé : FP8 rend l'IA avancée accessible

- Open source en tête : Les communautés innovent plus vite

- Architectures GPU décisives : AMD rend la puissance abordable

L'avenir ? Pas un auto-complete malin. Un partenaire qui capte votre projet entier, ses choix, patterns et limites.

RepomindAI n'est que le début.